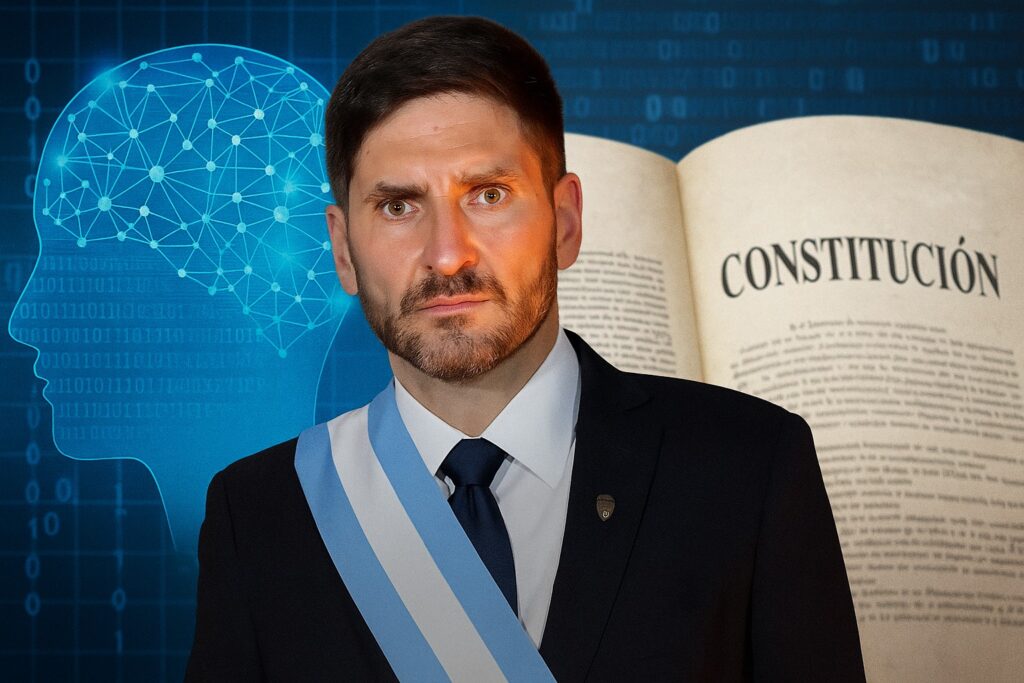

Pullaro decreta violar su propia Constitución: la trampa de la “IA auditable” en Santa Fe

La trampa central es que la IA generativa no es auditable y ningún decreto puede convertirla en algo que técnicamente no es. El texto promete “transparencia y trazabilidad”, pero solo lo declara en el papel: es como decretar que el agua de lluvia ya no mojará. El resultado es un protocolo que exige auditoría donde no puede haberla y que desplaza la responsabilidad a los empleados para sostener una ficción jurídica.

Apenas unos meses después de impulsar con bombos y platillos una reforma constitucional que exigía sistemas algorítmicos transparentes y auditables, el gobernador Maximiliano Pullaro firma un decreto que hace exactamente lo contrario: habilita el uso de inteligencia artificial generativa opaca, privada y no auditable en toda la administración pública santafesina. Y lo hace, además, escudándose en el mismo artículo que está vulnerando.

Detrás de la retórica “moderna” sobre innovación y eficiencia, el Decreto 2726/25 del 3 de noviembre –y su “Protocolo para la Adopción y Uso de Tecnologías de Inteligencia Artificial Generativa”– abre la puerta a un sistema peligroso en tres planos: jurídico (inconstitucional), tecnológico (in-auditable) y político (captura cognitiva y negocio para pocos).

De la cláusula de garantía al decreto contradictorio

La Constitución reformada de Santa Fe incorporó en su Artículo 29 un mandato categórico: la Provincia y quienes presten servicios de interés público deben adoptar sistemas algorítmicos transparentes y auditables, con evaluación de impacto y resguardo frente a sesgos. Ese estándar, presentado como avance “progresista” por el propio oficialismo, de hecho implicaba dejar afuera a los grandes modelos de IA generativa tipo ChatGPT, Gemini u otros equivalentes cerrados, cuya lógica interna no puede auditarse.

El nuevo decreto reconoce explícitamente esa cláusula… y en el mismo movimiento la vacía de contenido. Aprueba el uso de IAs generativas conversacionales en toda la administración, apoyándose en la promesa de que serán “transparentes, explicables y auditables” según el Protocolo.

Pero lo que el texto hace en la práctica es cambiar el objeto de la auditoría: no se audita la IA, sino al empleado. No se controla el modelo, sino si el agente “siguió el protocolo”. La supuesta “IA auditable” se convierte en un trabajador expuesto y un proveedor blindado.

Mientras tanto, no es un detalle menor: todo el bloque de La Libertad Avanza votó en contra de la cláusula que restringía el uso de IA en la reforma, advirtiendo justamente sobre el despropósito de legislar primero contra la herramienta y luego correr detrás del problema. Hoy el propio gobierno que impulsó esa redacción se ve obligado a violarla por decreto.

La farsa de la “IA auditable”

La Dra. Claudia Guardia, especialista en inteligencia artificial, lo explica con claridad: los modelos de IA generativa son cajas negras. No se puede seguir, paso a paso, cómo llegaron a una respuesta; no se puede reconstruir qué dato entrenado activó qué conexión; no se puede verificar si detrás hubo sesgos, recortes, presiones o simples errores estadísticos.

El Protocolo santafesino proclama que todo sistema utilizado “deberá ser transparente, explicable y auditable”, pero al mismo tiempo aclara que esto no implica abrir el código, ni la arquitectura, ni los datos de entrenamiento del proveedor. Es decir: la parte verdaderamente relevante de la IA sigue cerrada. Lo único “auditable” es el formulario donde el agente tilda que usó IA y firma que la supervisó.

La consecuencia es obvia:

- Auditoría de proceso (legalista): “¿El agente usó IA según el protocolo? ¿Firmó que la supervisó?”. Eso sí es auditable.

- Auditoría de influencia (el problema real): “¿La IA sesgó sutilmente la decisión hacia la conveniencia del gobierno o de un proveedor?”. Eso, con la tecnología actual y bajo contratos cerrados, es técnicamente in-auditable.

Prometer trazabilidad plena donde no la hay no es solo un error técnico: es engaño normativo para maquillar la inconstitucionalidad.

El eslabón más débil: el auditor humano como chivo expiatorio

El decreto confía todo en la “Supervisión Humana Significativa y Competente”. En el papel suena impecable. En la realidad administrativa es una invitación al desastre.

- Sesgo de automatización. Un empleado que procesa decenas de expedientes por día no va a desconfiar sistemáticamente de la IA: va a aceptar su salida como atajo. La “supervisión” se reduce a un clic.

- Influencias sutiles. La IA no necesita decir “votá al partido del gobierno”. Al redactar mil veces con el mismo lenguaje de “orden público”, “estabilidad”, “responsabilidad fiscal”, va moldeando el marco mental del redactor. Es el “nudge” invisible.

- Asimetría de conocimiento. Ni siquiera los ingenieros del proveedor pueden explicar en lenguaje jurídico por qué el modelo dio exactamente esa respuesta. Pretender que un agente administrativo santafesino “comprenda las limitaciones del modelo” es ficción.

- Alucinaciones complejas. Un modelo que mezcla jurisprudencia real con fallos inexistentes o doctrina inventada es casi imposible de auditar caso por caso. ¿Quién chequea 50 citas en cada dictamen?

El esquema diseñado por Pullaro traslada toda la responsabilidad al trabajador, pero deja intacto el núcleo opaco del sistema y del proveedor. Jurídicamente cómodo para el poder político; constitucionalmente insostenible.

El “Ministerio de la Verdad” vectorial y la captura cognitiva

Hay un punto aún más grave que la cuestión laboral: el control de la verdad oficial.

El propio Protocolo permite que la IA se alimente de bases de datos y documentos del Estado. En un esquema RAG, la IA “sabe” solo lo que está en su base vectorial. Si el gobierno cura esa base con una selección sesgada de doctrina, fallos o informes, no necesita modificar la ley: le basta con ajustar qué ve y qué no ve la máquina.

Ejemplo sencillo: un agente pregunta si hay argumentos legales para restringir una protesta. Si la base solo prioriza fallos de “orden público” y minimiza jurisprudencia de libertad de expresión, la IA responderá que sí, con citas “técnicas” incluidas. El agente creerá estar actuando objetivamente; en realidad estará dentro de un Ministerio de la Verdad algorítmico.

A esto se suman tres amenazas estratégicas:

- Soberanía cognitiva vulnerada. Si toda la administración usa el mismo modelo, con el mismo sesgo ideológico o corporativo, se homogeneiza el pensamiento interno. Todos los “auditores humanos” terminan pensando igual.

- Trazabilidad opaca. El decreto habla de registrar prompts y usos, pero jamás podrá reconstruirse el razonamiento interno del modelo ni los sesgos de entrenamiento.

- Dependencia tecnológica. Si la Provincia subordina su “inteligencia” a una empresa (pública o privada, nacional o extranjera), esa empresa gana palanca sobre decisiones, contratos y datos. Es el sueño húmedo de cualquier consorcio amigo del poder.

En ese contexto, la participación de laboratorios universitarios y estructuras cercanas al radicalismo y la Franja Morada –mencionados como inspiradores técnicos del decreto– merece, como mínimo, un escrutinio riguroso. El riesgo no es solo ético o económico: es que el cerebro digital del Estado quede tercerizado en manos con interés propio.